आजकल भारतीय शेयर बाजार में AI का इस्तेमाल तेजी से बढ़ रहा है, लेकिन आपको पता है कि AI हैलुसिनेशन आपके निवेश फैसलों को कितना नुकसान पहुंचा सकते हैं? अगर आप एक निवेशक, वित्तीय सलाहकार, या किसी वित्तीय संस्थान से जुड़े हैं, तो यह आपके लिए बेहद अहम है।

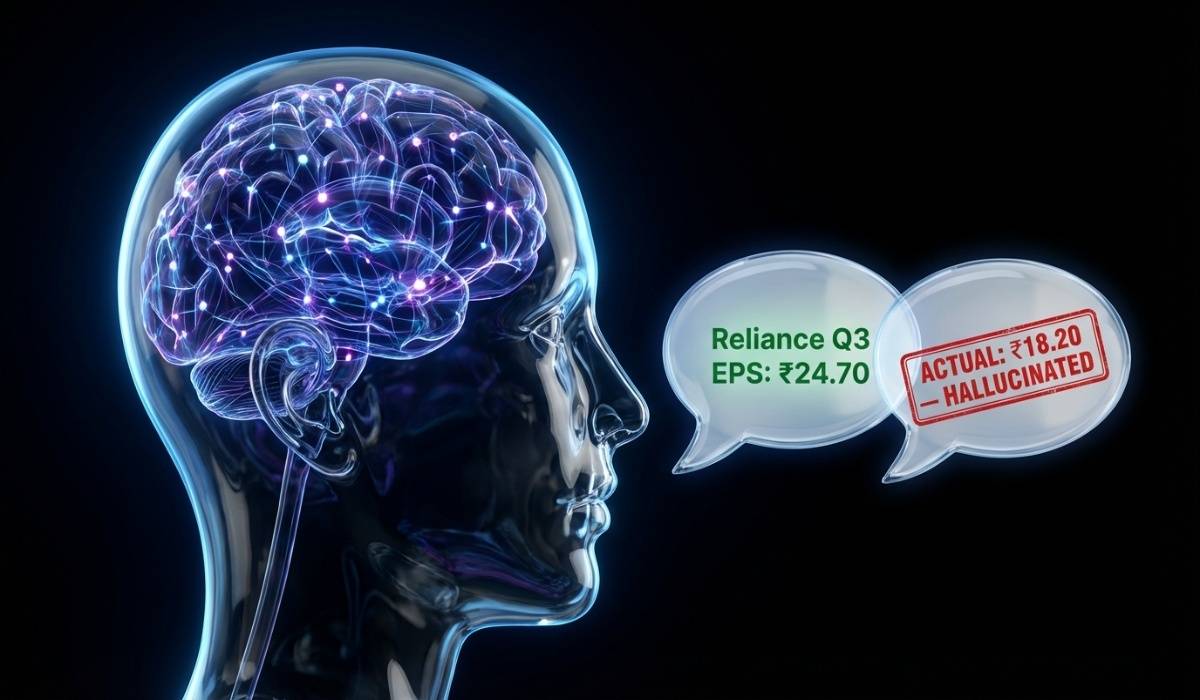

AI हैलुसिनेशन का मतलब है जब आर्टिफिशियल इंटेलिजेंस सिस्टम गलत या भ्रामक जानकारी देता है जो देखने में सच लगती है। स्टॉक मार्केट रिसर्च भारत में इसके खतरे और भी बढ़ जाते हैं क्योंकि यहां गलत डेटा की वजह से लाखों का नुकसान हो सकता है।

इस आर्टिकल में आपको जानने को मिलेगा कि AI हैलुसिनेशन क्या होता है और वित्तीय सेवाओं में इसके क्या खतरे हैं। हम वास्तविक केस स्टडी के जरिए दिखाएंगे कि इसका प्रभाव कितना गंभीर हो सकता है। साथ ही NIST AI रिस्क मैनेजमेंट फ्रेमवर्क के माध्यम से जोखिम प्रबंधन के तरीकों पर भी चर्चा करेंगे, और यह भी समझाएंगे कि वित्तीय संस्थानों में AI हैलुसिनेशन प्रबंधन में कौन सी भूमिकाएं और जिम्मेदारियां होनी चाहिए।

AI हैलुसिनेशन की परिभाषा और वित्तीय सेवाओं में इसके खतरे

आर्टिफिशियल इंटेलिजेंस में हैलुसिनेशन का मतलब

जब आप AI हैलुसिनेशन के बारे में सुनते हैं, तो यह समझना जरूरी है कि यह कोई तकनीकी ग्लिच नहीं बल्कि AI सिस्टम की मौलिक चुनौती है। AI हैलुसिनेशन तब होता है जब आर्टिफिशियल इंटेलिजेंस मॉडल ऐसी जानकारी प्रदान करता है जो सुनने में तो सही लगती है लेकिन वास्तविकता में गलत होती है।

यह समस्या इसलिए उत्पन्न होती है क्योंकि जेनेरेटिव AI मॉडल्स को सच्चाई को वेरिफाई करने के लिए नहीं बल्कि संभावित आउटपुट्स की भविष्यवाणी करने के लिए डिज़ाइन किया गया है। आपके सामने जो AI सिस्टम काम कर रहा है, वह वास्तव में अपने प्रशिक्षण डेटा से पैटर्न के आधार पर अगले शब्द या वाक्य की सांख्यिकीय भविष्यवाणी कर रहा है।

इन AI सिस्टम्स का मुख्य लक्ष्य fluency (धाराप्रवाहता) और relevance (प्रासंगिकता) होता है – accuracy (सटीकता) नहीं। यही कारण है कि जब मॉडल को सही उत्तर नहीं पता होता, तो वह ऐसी जानकारी का आविष्कार कर देता है जो सुनने में विश्वसनीय लगती है लेकिन पूरी तरह गलत होती है।

वित्तीय सेवा उद्योग में AI हैलुसिनेशन के गंभीर परिणाम

वित्तीय सेवाओं में AI हैलुसिनेशन के परिणाम विशेष रूप से गंभीर हो सकते हैं। जब आप वित्तीय संस्थान के रूप में AI का उपयोग करते हैं, तो एक गलत सलाह आपके ग्राहकों के लिए भारी नुकसान का कारण बन सकती है।

ब्रांड की विश्वसनीयता पर प्रभाव

आपके ग्राहक शायद ही कभी यह अंतर करें कि “AI ने गलती की है” या “आपकी कंपनी ने गलत जानकारी दी है।” Google के Bard चैटबॉट के मामले में, एक गलत दावे के कारण कंपनी का स्टॉक 8-9% गिर गया और उसका बाजार पूंजीकरण $100 बिलियन कम हो गया।

वित्तीय नुकसान और छुपी हुई लागतें

यदि आपका AI असिस्टेंट गलत ब्याज दर या गलत जोखिम मूल्यांकन प्रदान करता है, तो इस पर कार्य करने वाले ग्राहक या बैंकर के लिए वित्तीय नुकसान हो सकता है। इसके अतिरिक्त, आपको निरंतर मानवीय निगरानी में निवेश करना पड़ता है, जो AI की दक्षता लाभ को कम कर देता है।

कानूनी देयता और अनुपालन जोखिम

नियंत्रित वित्तीय क्षेत्र में, AI द्वारा गलत जानकारी प्रदान करना आपको कानूनी परेशानी में डाल सकती है। ChatGPT ने एक ऑस्ट्रेलियाई मेयर के बारे में झूठा रिश्वतखोरी का आरोप लगाया था, जिससे मानहानि का मुकदमा लगभग तय हो गया था।

भारतीय शेयर बाजार अनुसंधान में संभावित जोखिम क्षेत्र

भारतीय शेयर बाजार अनुसंधान में AI हैलुसिनेशन के विशिष्ट जोखिम क्षेत्र हैं जिन पर आपको विशेष ध्यान देना चाहिए:

निवेश सलाह और पोर्टफोलियो प्रबंधन

जब आप AI-संचालित robo-advisors या व्यक्तिगत सहायकों का उपयोग करते हैं, तो गलत निवेश सिफारिशें या जोखिम प्रोफाइल मिसमैच के कारण ग्राहकों को भारी नुकसान हो सकता है। यह विशेष रूप से खतरनाक है क्योंकि निवेशक AI की सलाह को अधिक विश्वसनीय मान सकते हैं।

ट्रेजरी प्रबंधन और तरलता आकलन

गैर-वित्तीय फर्मों के लिए AI-आधारित ट्रेजरी मैनेजमेंट सोल्यूशन में गलत तरलता आवश्यकताओं या वित्तीय रिटर्न की गणना हो सकती है, जिससे कैश फ्लो की समस्याएं हो सकती हैं।

धोखाधड़ी का पता लगाना और जोखिम मूल्यांकन

यदि आपके automated fraud detection सिस्टम में हैलुसिनेशन होता है, तो वैध लेन-देन को गलत तरीके से फ्लैग किया जा सकता है या वास्तविक धोखाधड़ी छूट सकती है।

बाजार हेरिंग व्यवहार

जब व्यक्ति और कंपनियां कम संख्या में AI प्रदाताओं पर निर्भर रहती हैं, तो यह herding behavior का कारण बन सकता है, जिससे bank runs या flash crashes हो सकते हैं। यह भारतीय वित्तीय स्थिरता के लिए गंभीर खतरा है।

AI हैलुसिनेशन के वास्तविक मामले और उनका प्रभाव

अमेरिकी कानूनी मामले में ChatGPT की गलत जानकारी

2023 में एक महत्वपूर्ण घटना घटी जब दो अमेरिकी वकीलों को न्यायाधीश द्वारा दंडित किया गया। इन वकीलों ने ChatGPT का उपयोग करके एक कानूनी ब्रीफ तैयार किया था, जिसमें छह ऐसे मामलों के उदाहरण दिए गए थे जो वास्तव में अस्तित्व में ही नहीं थे। यह AI हैलुसिनेशन का एक स्पष्ट उदाहरण था, जहाँ AI ने पूर्ण आत्मविश्वास के साथ गलत जानकारी प्रस्तुत की।

इसी प्रकार, Air Canada के मामले में कंपनी के चैटबॉट ने एक यात्री को गलत रिफंड पॉलिसी की जानकारी दी थी। इस घटना के कारण कंपनी को न केवल यात्री को मुआवजा देना पड़ा बल्कि कानूनी और प्रतिष्ठा संबंधी नुकसान का भी सामना करना पड़ा। ये दोनों घटनाएं दर्शाती हैं कि जब आप AI सिस्टम पर भरोसा करते हैं, तो सत्यापन की आवश्यकता कितनी महत्वपूर्ण होती है।

कानूनी और नियामक क्षेत्र में मिले सबक

अब जब हमने इन वास्तविक मामलों को देखा है, तो यह स्पष्ट हो जाता है कि AI हैलुसिनेशन के कारण आपको कई गंभीर चुनौतियों का सामना करना पड़ सकता है। सबसे पहले, नियामक अनुपालन जोखिम सबसे बड़ी चुनौती है। जब आप वित्तीय सेवाओं में काम करते हैं तो SEC जैसी नियामक एजेंसियां सख्त नियमों का पालन करने की अपेक्षा करती हैं। यदि AI की गलत जानकारी के कारण गलत प्रकटीकरण या सलाह दी जाती है, तो इससे गैर-अनुपालन और भारी जुर्माना हो सकता है।

दूसरा मुख्य सबक यह है कि पारदर्शिता और स्रोत सत्यापन अत्यंत आवश्यक है। जब आप AI के किसी उत्तर का उपयोग करते हैं तो नियामकों के लिए यह जानना आवश्यक होता है कि यह जानकारी कहाँ से आई है। यदि आपका AI सिस्टम अपने उत्तर के स्रोत नहीं दिखा सकता, तो यह एक ब्लैक बॉक्स बन जाता है जिसे नियामक स्वीकार नहीं करते।

वित्तीय संस्थानों के लिए चेतावनी के संकेत

इन मामलों के अध्ययन से यह स्पष्ट हो गया है कि जब आप वित्तीय संस्थान में AI का उपयोग करते हैं, तो आपको कई विशिष्ट खतरों से सावधान रहना चाहिए। प्रतिष्ठा हानि सबसे बड़ा जोखिम है – यदि आपका बैंक या बीमा कंपनी का AI सिस्टम गलत जानकारी देता है, तो ग्राहकों का विश्वास खो सकता है, जो वित्तीय सेवाओं में विशेष रूप से नाजुक होता है।

वित्तीय जोखिम भी महत्वपूर्ण है – गलत आउटपुट के कारण गलत निवेश निर्णय, गलत अंडरराइटिंग गणना या धोखाधड़ी की गलत पहचान हो सकती है। एक सर्वेक्षण के अनुसार 47% कार्यकारियों ने स्वीकार किया है कि वे गलत AI सामग्री पर आधारित निर्णय ले चुके हैं।

परिचालन अक्षमता भी एक गंभीर चिंता है। यदि जोखिम मॉडलिंग या रिपोर्टिंग के लिए AI-जेनेरेटेड कोड में त्रुटियां हैं, तो आपकी IT टीम को समस्याओं को ठीक करने में शुरू से समाधान बनाने से अधिक समय लग सकता है। इससे लागत में वृद्धि होती है और उत्पादकता में कमी आती है।

NIST AI रिस्क मैनेजमेंट फ्रेमवर्क के माध्यम से जोखिम प्रबंधन

AI सिस्टम की सीमाओं का दस्तावेजीकरण और मानवीय निरीक्षण

NIST AI रिस्क मैनेजमेंट फ्रेमवर्क के अनुसार, आपको अपने AI हैलुसिनेशन प्रबंधन की शुरुआत व्यापक दस्तावेजीकरण से करनी चाहिए। जब आप वित्तीय संस्थानों में आर्टिफिशियल इंटेलिजेंस का उपयोग करते हैं, तो आपको प्रत्येक AI सिस्टम की स्पष्ट सीमाओं को परिभाषित करना होगा।

NIST फ्रेमवर्क के तहत आपको निम्नलिखित बिंदुओं पर ध्यान देना चाहिए:

डेटा की गुणवत्ता और सीमाएं: आपके AI मॉडल किस प्रकार के डेटा पर प्रशिक्षित हैं

मॉडल की परिचालन सीमाएं: किन परिस्थितियों में आपका AI सटीक परिणाम दे सकता है

मानवीय हस्तक्षेप के बिंदु: कब और कहाँ मानवीय निरीक्षण आवश्यक है

आपको trustworthiness considerations को डिज़ाइन, विकास, उपयोग और मूल्यांकन के प्रत्येक चरण में शामिल करना होगा। यह सुनिश्चित करता है कि आपके स्टॉक मार्केट रिसर्च भारत में उपयोग होने वाले AI सिस्टम विश्वसनीय रहें।

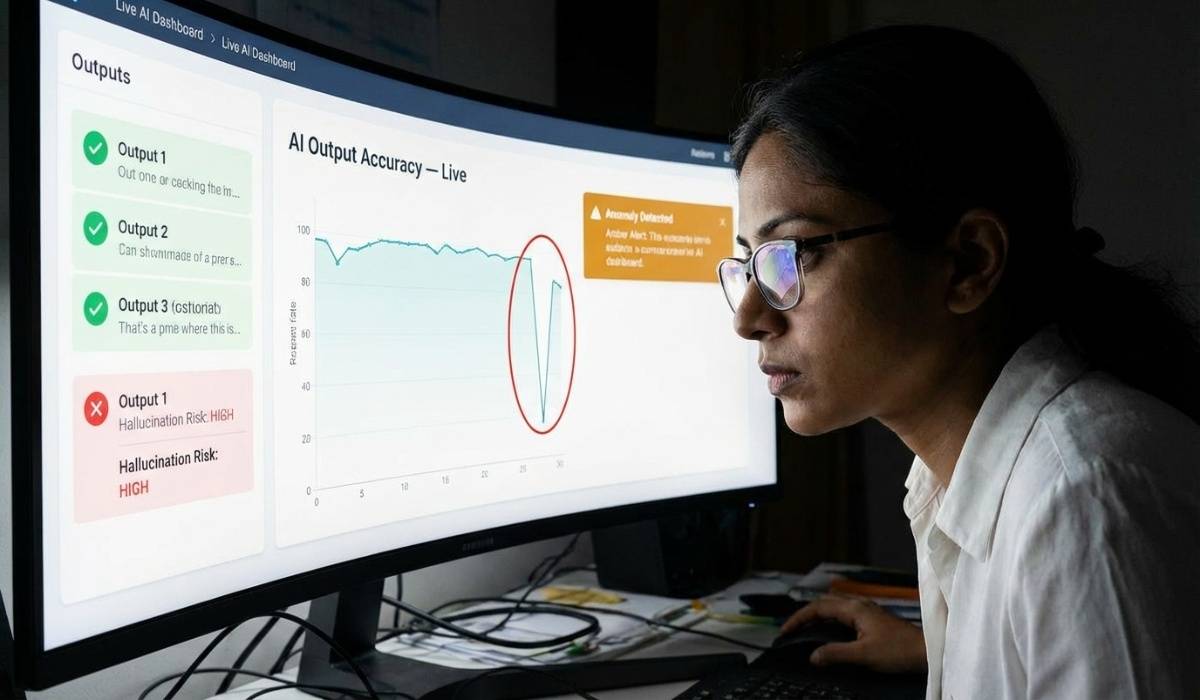

निरंतर निगरानी और AI आउटपुट की सत्यापना प्रक्रिया

Previous section में सीमाओं के दस्तावेजीकरण के बाद, आपको एक मजबूत निगरानी प्रणाली स्थापित करनी चाहिए। NIST AI RMF Playbook के अनुसार, आपको निरंतर निगरानी के लिए निम्नलिखित रणनीति अपनानी चाहिए:

तत्काल सत्यापना प्रक्रियाएं:

रियल-टाइम AI आउटपुट मॉनिटरिंग

स्वचालित anomaly detection सिस्टम

नियमित accuracy checks और validation

वित्तीय AI सिक्योरिटी के लिए आपको multi-layered approach अपनाना होगा। जब आप शेयर बाजार में AI खतरे का सामना करते हैं, तो निरंतर निगरानी आपकी पहली रक्षा पंक्ति है। NIST framework के अनुसार, आपको अपने AI सिस्टम के प्रदर्शन को लगातार track करना चाहिए और किसी भी deviation की स्थिति में तुरंत corrective action लेना चाहिए।

पारदर्शिता और ट्रेसेबिलिटी सुनिश्चित करने के तरीके

Now that we have covered निगरानी प्रक्रिया, AI जोखिम प्रबंधन भारत में पारदर्शिता महत्वपूर्ण है। NIST के collaborative process और transparent approach के आधार पर, आपको निम्नलिखित उपाय अपनाने चाहिए:

ट्रेसेबिलिटी सुनिश्चित करने के तरीके:

| घटक | आवश्यकताएं | लाभ |

|---|---|---|

| Decision Audit Trail | प्रत्येक AI निर्णय का record | जवाबदेही सुनिश्चित करना |

| Data Lineage | डेटा के स्रोत और प्रसंस्करण का track | quality assurance |

| Model Versioning | AI मॉडल के versions का documentation | performance comparison |

वित्तीय सेवाओं में AI जोखिम प्रबंधन के लिए आपको हर AI-generated recommendation या analysis के लिए पूर्ण ट्रेसेबिलिटी maintain करनी चाहिए। NIST framework के अनुसार, यह consensus-driven और open approach आपको regulatory compliance में भी मदद करेगा।

With this comprehensive framework in mind, आपको याद रखना चाहिए कि NIST AI RMF voluntary use के लिए डिज़ाइन किया गया है, लेकिन AI हैलुसिनेशन के खतरों को देखते हुए, इसका कार्यान्वयन आपकी संस्था की विश्वसनीयता के लिए आवश्यक है।

वित्तीय संस्थानों में AI हैलुसिनेशन प्रबंधन की भूमिकाएं और जिम्मेदारियां

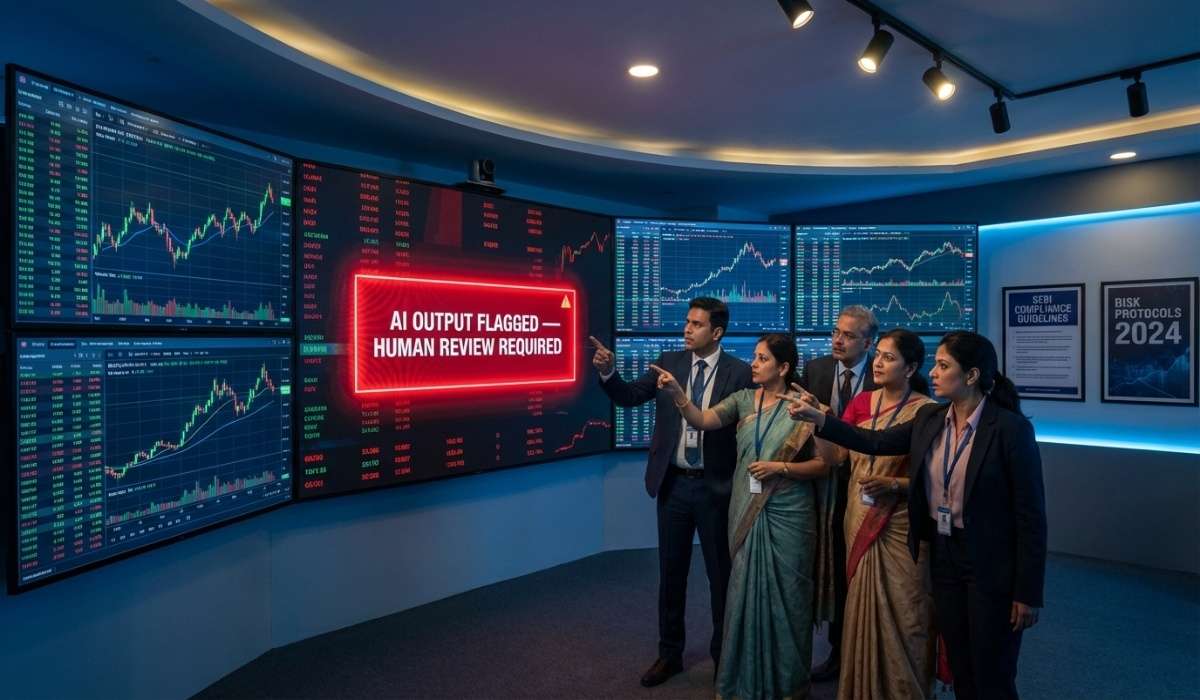

मुख्य अधिकारियों की जवाबदेही और निरीक्षण भूमिका

आपके वित्तीय संस्थान में AI हैलुसिनेशन प्रबंधन की शुरुआत सबसे ऊपर से होनी चाहिए। आपके वरिष्ठ नेतृत्व को AI के नैतिक और जिम्मेदार उपयोग को बढ़ावा देना होगा। एक समर्पित AI एथिक्स कमेटी का गठन करना आवश्यक है, जहाँ IT, अनुपालन, कानूनी और अन्य विभागों के नेता नियमित रूप से परियोजनाओं की समीक्षा करें, भूमिकाओं को परिभाषित करें, और AI विकास और निरीक्षण के लिए मानक निर्धारित करें।

आपको AI दिशानिर्देशों के कार्यान्वयन की देखरेख के लिए एक विशिष्ट भूमिका निर्धारित करनी होगी और AI जोखिम प्रबंधन भारत के संदर्भ में मौजूदा जोखिम ढांचों में AI जोखिम प्रबंधन को एकीकृत करना होगा। आपके संगठन में 55% संस्थानों में अभी तक AI गवर्नेंस फ्रेमवर्क लागू नहीं है, इसलिए तत्काल कार्रवाई की आवश्यकता है।

तकनीकी टीमों और विकासकर्ताओं की कार्यान्वयन जिम्मेदारियां

वित्तीय संस्थानों में आर्टिफिशियल इंटेलिजेंस के संदर्भ में, आपकी तकनीकी टीमों को निरंतर प्रशिक्षण कार्यक्रमों का कार्यान्वयन करना होगा ताकि कर्मचारी AI गवर्नेंस नीतियों और सर्वोत्तम प्रथाओं पर अद्यतन रह सकें। आपको AI सिस्टम की निगरानी और ऑडिटिंग के लिए उपकरणों का एकीकरण करना होगा जो निरंतर अनुपालन और प्रदर्शन सुनिश्चित करे।

आपकी टीम को निम्नलिखित क्षेत्रों पर ध्यान देना होगा:

एन्क्रिप्शन और एक्सेस कंट्रोल: संवेदनशील जानकारी की सुरक्षा के लिए

नियमित ऑडिट: सुरक्षा उपायों की अखंडता बनाए रखने के लिए

डेटा प्राइवेसी और सिक्योरिटी: कर्मचारियों को बेस्ट प्रैक्टिसेज पर शिक्षित करना

आपको स्टॉक मार्केट रिसर्च भारत के संदर्भ में विशेष रूप से सतर्क रहना होगा क्योंकि गलत जानकारी के गंभीर परिणाम हो सकते हैं।

Read: इन्वेस्टिंग में AI हैलुसिनेशन: 3 महंगे उदाहरण

अनुपालन और कानूनी सलाहकारों की सहायक भूमिका

बैंकिंग में नियामक अनुपालन महत्वपूर्ण है। आपको अपनी AI नीतियों को GDPR, PSD2, और अन्य स्थानीय तथा अंतर्राष्ट्रीय मानकों के साथ संरेखित करना होगा जो डेटा सुरक्षा और उपभोक्ता अधिकारों को नियंत्रित करते हैं।

आपके कानूनी सलाहकारों को निम्नलिखित कार्य करने होंगे:

नियमित डेटा प्रोटेक्शन इंपैक्ट असेसमेंट (DPIA): जोखिमों की पहचान और कमी के लिए

अनुपालन लीड की नियुक्ति: इन प्रयासों की देखरेख के लिए

डेटा उल्लंघन प्रोटोकॉल: AI एथिक्स कमेटी के साथ मिलकर विकसित करना

वित्तीय AI सिक्योरिटी के संदर्भ में, आपको यह सुनिश्चित करना होगा कि आपके AI सिस्टम सुरक्षित और पारदर्शी हों। NIST AI रिस्क मैनेजमेंट फ्रेमवर्क जैसे स्थापित ढांचों से शुरुआत करके, आप अपनी संस्था के आकार और आवश्यकताओं के अनुकूल समाधान विकसित कर सकते हैं।

भारतीय वित्तीय बाजार में AI हैलुसिनेशन का खतरा एक गंभीर चुनौती है जिसे आप नजरअंदाज नहीं कर सकते। जैसा कि कानूनी क्षेत्र में ChatGPT के गलत केस साइटेशन के मामले से स्पष्ट होता है, AI सिस्टम विश्वसनीय लगने वाली लेकिन पूरी तरह से गलत जानकारी प्रदान कर सकते हैं। यह आपके स्टॉक रिसर्च और निवेश निर्णयों में गंभीर वित्तीय नुकसान का कारण बन सकता है।

NIST AI रिस्क मैनेजमेंट फ्रेमवर्क के माध्यम से आप AI हैलुसिनेशन के जोखिमों को प्रभावी रूप से प्रबंधित कर सकते हैं। आपको AI सिस्टम की सीमाओं को समझना, निरंतर मॉनिटरिंग करना, और मानवीय निगरानी सुनिश्चित करना होगा। आपकी संस्था में CIO, CRO, और AI इंजीनियरों सहित विभिन्न भूमिकाओं की स्पष्ट जिम्मेदारियां निर्धारित करना आवश्यक है। AI के लाभों का पूरा फायदा उठाते समय इन नियंत्रणों को अपनाकर आप भारतीय वित्तीय बाजार में सुरक्षित और विश्वसनीय AI-संचालित निवेश रणनीति विकसित कर सकते हैं।